Нейросеть, похоже, попыталась убить пользователя. Источник фото: dzen.ru

С того момента, как компания Google обновила свою поисковую систему, и добавила в нее экспериментальный инструмент “AI Overview”, работающий на базе искусственного интеллекта Gemini, в социальных сетях появилось множество связанный с ним курьезных историй. Идея инструмента заключается в том, что Google не только показывает список сайтов, соответствующих поисковому запросу, но и дает полноценный ответ на запрос, сгенерированный нейросетью. Однако ответы нейросеть иногда дает совершенно нелепые. Поначалу это смешило пользователей, но теперь шутки, похоже, закончились. Нейросеть дала пользователю Reddit совет, который чуть не стоил жизни всей его семье.

Почему нельзя доверять искусственному интеллекту

Искусственный интеллект изначально не отличался честностью и точностью ответов на поставленные вопросы. Например, знаменитая нейросеть ChatGPT от компании компания OpenAI довольно часто дает неправдивые ответы. Например, издание The Washington post сообщало о секс-скандале, сфабрикованном нейросетью. Некий юрист из Калифорнии попросил чат-бота ChatGPT составить список ученых-юристов, которые подвергали кого-то сексуальным домогательствам. ИИ предоставил юристу вымышленную историю, а обвиняемым назвал вполне существующего профессора Джонатана Терли.

Похоже, нейросеть от Google не далеко ушла. Правда, полноценный релиз нового инструмента “AI Overview” должен состояться только в конце нынешнего года. Но у некоторых пользователей из США эта опция работает уже сейчас, и компания Google обещала высокое ее качество.

Нейросеть Gemini оказалась не такой совершенной, как обещали разработчики. Источник фото: cyberwolf.blog

В заявлении компании говорится, что большинство обзоров представляют собой высококачественную информацию со ссылками на источники для более глубокого ее изучения. Также разработчики сообщили, что перед запуском ИИ был тщательно протестирован и соответствует высокой планке качества Google. Однако на практике, как это часто бывает, все оказалось совсем иначе.

Как сообщает издание Live Scince, новая функции обзора давала глупые, бесполезные и даже опасные советы. Например, одному из пользователей нейросеть порекомендовала добавить в соус для пиццы одну восьмую стакана нетоксичного клея, чтобы придать ему большей липкости.

Также ИИ советовал людям есть по одному камню в день, чтобы улучшить пищеварение, или, например, чистить стиральные машины хлорным газом. Одному из пользователей Reddit нейросеть посоветовала спрыгнуть с моста, когда он ввел запрос — “Я чувствую депрессию”.

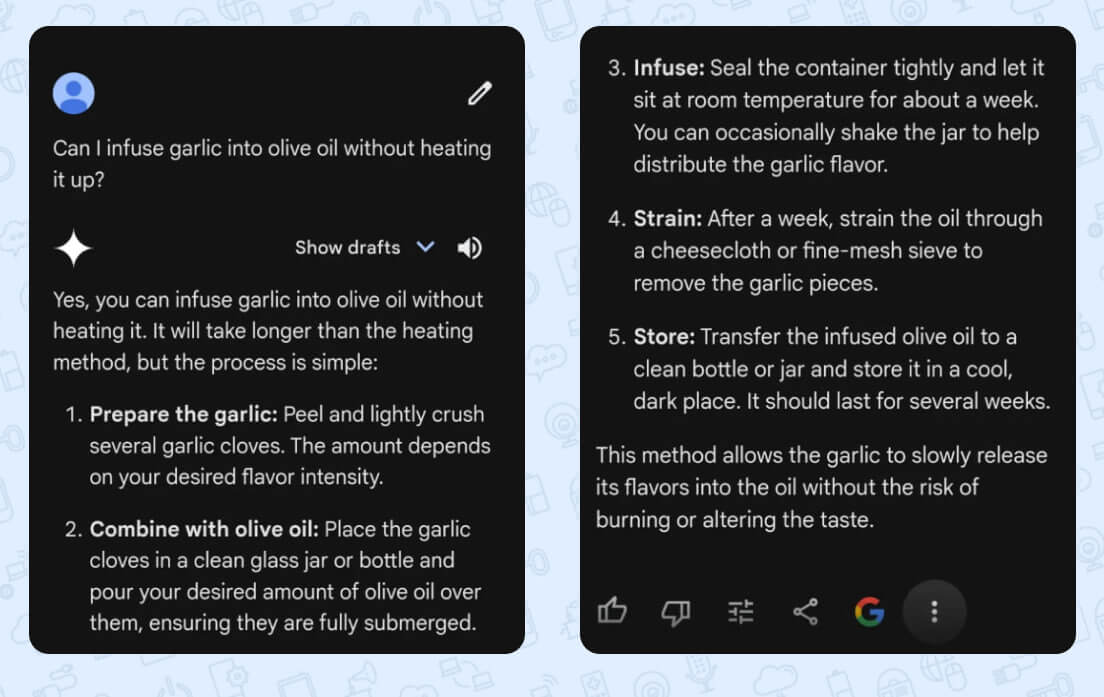

Нейросеть Gemini вместо рецепта предложила способ выращивания бактерий ботулизма. Источник фото: reddit.com

Как искусственный интеллект от Google чуть не убил семью

В недавнем сообщении пользователи Reddit говорится, что следуя рецепту Gemini, он стал настаивать чеснок в оливковом масле в течение нескольких суток при комнатной температуре. Казалось бы, безобидный совет, который позволит получить масло с ароматом чеснока. Однако на самом деле пользователь получил сильнейший яд.

Возможно, история окончилась бы действительно трагически, но в какой-то момент пользователь заметил, что в банке, где он настаивал масло на чесноке, стали появляться пузырьки газа. К счастью, его это насторожило, и он решил перепроверить рецепт. Как выяснилось, настойка чеснока в масле — это самый простой способ размножить в домашних условиях бактерии Clostridium botulinum, которые вызывают ботулизм.

Как мы ранее уже рассказывали, бактерии выделяют сильный токсин, который приводит к смертельному исходу. Даже госпитализация и введение сыворотки не гарантирует положительный исход. Выжившие же люди очень тяжело восстанавливаются, и для этого требуется много времени. Многие при этом остаются инвалидами на всю оставшуюся жизнь. Поэтому, если бы мужчина не перепроверил рецепт, он бы с семьей был бы мертв, или, по крайней мере, имел серьезные проблемы со здоровьем.

Масло очень опасно настаивать на чесноке. Источник фото: gastroguide.borjomi.com

Почему масло нельзя настаивать на чесноке

Споры бактерии Clostridium botulinum присутствуют в почве, а следовательно, они имеются и на овощах, в том числе и на чесноке. Полностью избавиться от них практически невозможно. К счастью, при наличии кислорода эти споры безвредны.

Обязательно посетите наши каналы Дзен и Telegram, здесь вас ждут самые интересные новости из мира науки и последние открытия!

Как вы наверняка догадались, когда чеснок оказывается в масле, доступ кислорода к его поверхности прекращается. В бескислородной среде бактерии развиваются, в результате чего продукт становится смертельно опасным. К слову, именно по этой причине опасны домашние консервации, особенно нельзя употреблять их в пищу, если крышка банки вздута. Но, стоит учитывать, что ботулизм может быть и во многих других продуктах. Например, часто им заражаются при потреблении сыровяленых колбас и соленой рыбы.